La era de los Small Language Models (SLM): El futuro de la IA ahora vive dentro de tu móvil

En 2026, la IA ha dejado de depender solo de grandes servidores. Bienvenidos a la revolución de los SLM: modelos compactos, privados y ultrarrápidos que se ejecutan sin conexión.

Durante los últimos tres años, hemos vivido bajo la dictadura de la nube. Si querías una respuesta inteligente de un chatbot, tus datos debían viajar a un centro de datos a miles de kilómetros y volver. Pero hoy, 2 de abril de 2026, la industria del smartphone ha alcanzado un consenso tecnológico: el futuro no está en los grandes modelos (LLM), sino en los Small Language Models (SLM).

Hoy en Techmentoria analizamos por qué gigantes como Apple, Samsung y Xiaomi están desplazando el peso de la IA desde sus servidores hasta el silicio que llevas en el bolsillo. La IA local ha dejado de ser una curiosidad técnica para convertirse en la única vía sostenible por privacidad, coste y velocidad.

¿Qué es un SLM y por qué es mejor que GPT-4 para tu iPhone?

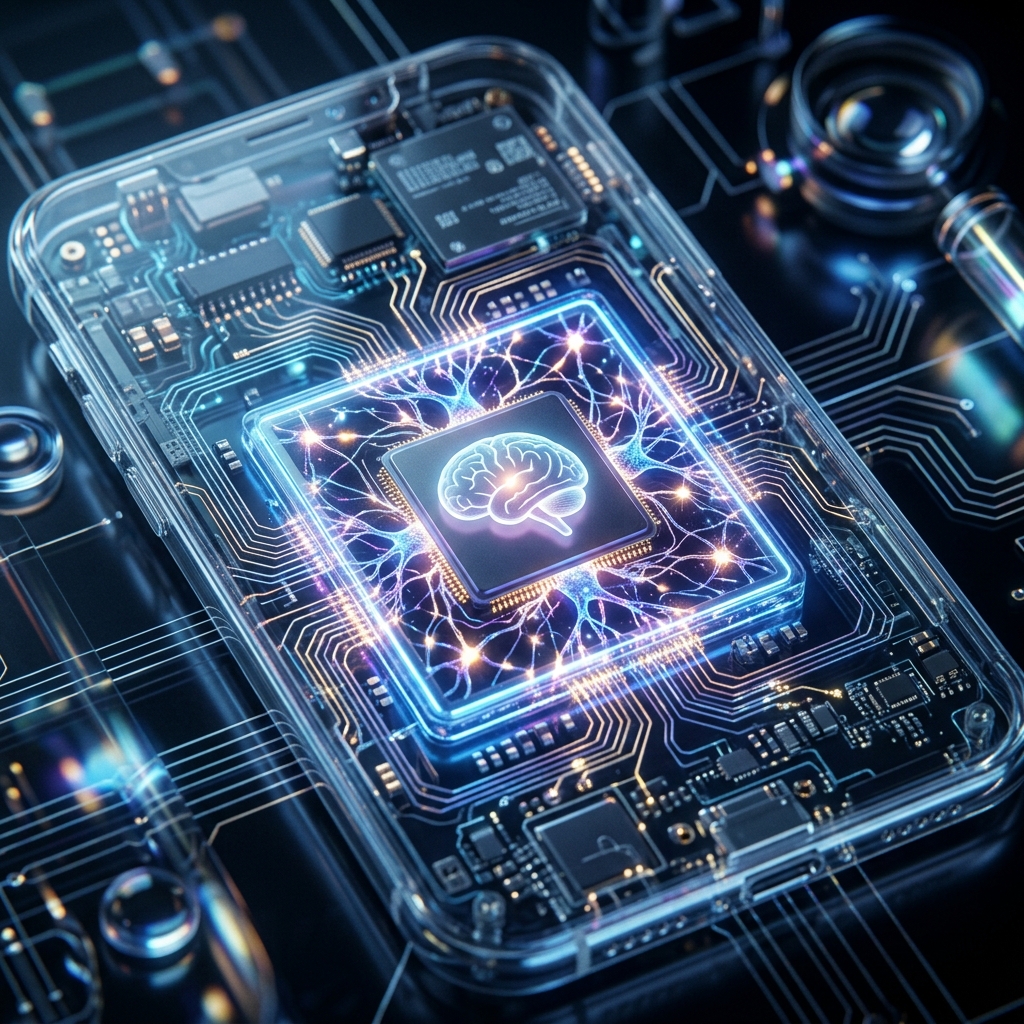

A diferencia de un LLM como GPT-4o o Gemini 1.5 Pro, que requieren cientos de gigabytes de memoria gráfica y energía constante, un Small Language Model (como los nuevos modelos 'Phi' de Microsoft o la serie 'Nano' de Google) está optimizado para funcionar con apenas un puñado de miles de millones de parámetros.

Gracias a técnicas de compresión como la cuantización y la destilación de conocimiento, estos modelos son capaces de razonar con una precisión asombrosa usando menos de la mitad de la RAM de un smartphone moderno. Esto permite realizar tareas como resumir correos, redactar mensajes o traducir conversaciones en tiempo real de forma totalmente offline.

Las tres ventajas clave del procesamiento local

El cambio hacia el SLM local no es solo una elección técnica de los fabricantes; es una respuesta a las demandas de los usuarios en 2026:

- Privacidad Extrema: Tus datos personales, fotos y anotaciones laborales nunca salen del teléfono. No hay riesgo de filtraciones en la nube o de que tus datos se usen para entrenar modelos de IA de terceros.

- Latencia Cero: Al no depender de la latencia de red (especialmente crítica en viajes o zonas con poca cobertura), la respuesta de la IA es instantánea. La interacción se siente natural, como una conversación humana real.

- Ahorro de Costes y Batería: Enviar cada petición a un servidor consume una energía considerable y tiene un coste operativo inmenso para las empresas. Ejecutar un SLM aprovechando la NPU (unidad de procesamiento neuronal) de un chip como el Snapdragon 8 Gen 5 es órdenes de magnitud más eficiente.

Apple y Samsung: La guerra por el 'On-Device AI'

Apple ha liderado este cambio con su arquitectura Private Cloud Compute, pero su verdadero objetivo es que el 90% de las consultas de Siri Extensions se resuelvan localmente en el iPhone 17. Esto permite que el teléfono sea proactivo: puede analizar tu agenda y tus notificaciones sin que Apple sepa qué estás haciendo en cada momento.

Por su parte, Samsung ha presentado hoy nuevas integraciones de su Galaxy AI basadas en una versión personalizada de Gemma 2 (de Google). Sus nuevos plegables han demostrado ser capaces de realizar análisis de hojas de cálculo complejas de forma local, algo impensable hace solo un año.

Análisis de Profundidad: ¿Es el fin de los modelos grandes?

En Techmentoria creemos que no. Lo que estamos viendo es un modelo híbrido. Los LLM de la nube seguirán existiendo para tareas pesadas como la generación de vídeo cinematográfico o la investigación científica compleja. Pero para el 95% de nuestras necesidades diarias —gestión de agenda, retoque fotográfico inteligente o redacción rápida—, el SLM es más que suficiente.

La tecnología ha alcanzado un "punto dulce" donde el hardware de nuestros móviles es tan potente que los modelos pequeños ya no se sienten "tontos". Son, literalmente, ayudantes especialistas que viven con nosotros sin la correa de una conexión a internet.

Perspectiva Editorial Techmentoria

En Techmentoria vemos este cambio como la verdadera madurez de la inteligencia artificial. La IA deja de ser una "página web a la que entras" para ser una característica intrínseca del hardware, como lo fue en su día el WiFi o la cámara. Si vas a comprar un móvil este año, no mires solo los megapíxeles; asegúrate de que tiene una NPU capaz de ejecutar SLMs de última generación. Es la diferencia entre tener un teléfono conectado a la IA o un teléfono que es inteligencia artificial.

[!IMPORTANT] Para disfrutar de los SLMs más avanzados, es recomendable contar con dispositivos que tengan al menos 12GB o 16GB de RAM LPDDR6, ya que aunque los modelos son pequeños, necesitan gran ancho de banda para ser realmente fluidos.

Preguntas Frecuentes (FAQ)

¿Puede un SLM hacer lo mismo que ChatGPT? En tareas de escritura creativa compleja, los modelos grandes siguen ganando. Pero en tareas de lógica, organización y gestión de apps, la diferencia es casi imperceptible para el usuario común.

¿Gastará mucha batería tener la IA corriendo en local? Curiosamente, suele gastar menos que mantener una conexión de datos 5G constante enviando y recibiendo información de un servidor externo durante mucho tiempo. Las NPUs modernas están diseñadas para ser ultrafincas en consumo eléctrico.

¿Tengo que descargar los modelos manualmente? Normalmente no. Apple y Samsung actualizan los modelos localmente de forma silenciosa durante las actualizaciones de sistema operativo o a través de la tienda de aplicaciones en segundo plano.

¿Funciona la IA local en móviles antiguos? Depende del chip. Dispositivos de gama media o baja anteriores a 2024 carecen de la NPU necesaria para ejecutar estos modelos con dignidad, por lo que seguirán dependiendo de la nube (si el fabricante lo permite).

¿Prefieres que tu móvil sea 100% privado aunque la IA sea un poco menos potente, o no te importa que tus datos viajen a la nube a cambio del modelo más inteligente posible? Cuéntanos tu experiencia.